Алгоритмите зад интелигентната игра

Как мисли Изкуственият интелект?

За да победи в непозната игра, ИИ не може да разчита на „късмет“. Той използва сложни математически структури, които му позволяват да предвижда бъдещето. Основният стълб в модерните GGP системи е комбинацията от класическо търсене и невронни мрежи.

1. Monte Carlo Tree Search (MCTS): Изкуството на симулацията

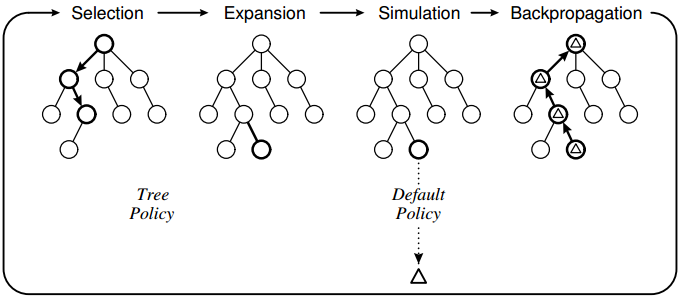

MCTS е алгоритъмът, който направи възможна победата на машините в игри със сложна стратегия. Вместо да проверява абсолютно всички възможни ходове (което е невъзможно при сложни игри), MCTS работи чрез:

-

Селекция: Избира най-обещаващите ходове въз основа на досегашния опит.

-

Експанзия: Добавя нови възможни състояния към „дървото на решенията“.

-

Симулация: Разиграва играта до самия край (често на случаен принцип), за да види какъв е резултатът.

-

Обратно разпространение: Връща информацията за победа или загуба нагоре по дървото, за да актуализира статистиката на ходовете.

2. Ролята на Deep Learning (DL)

В доклада си Камен Банков разглежда как класическият MCTS се подобрява чрез Deep Learning.

-

Политика (Policy Network): Невронната мрежа помага на алгоритъма да „стесни“ избора си, като му казва кои ходове са най-логични за изпробване.

-

Оценка (Value Network): Вместо да разиграва играта до края, ИИ може просто да „погледне“ дъската и да прецени: „В тази позиция имам 80% шанс за победа“. Това спестява огромно количество изчислителна мощ.

3. Търсене срещу Интуиция

Ключът към успеха, описан в разработката, е балансът между:

-

Exploitation (Експлоатация): Използване на вече познати добри ходове.

-

Exploration (Изследване): Търсене на нови, непознати пътища, които може да се окажат по-добри.

Този механизъм позволява на GGP агента да се адаптира към всяка нова игра – от простото „Морски шах“ до комплексни аркадни заглавия.